Meta社が7月2日に、1分未満でテキストから3Dモデルを生成出来る技術「Meta 3D Gen」を発表しました!

Meta 3D Gen

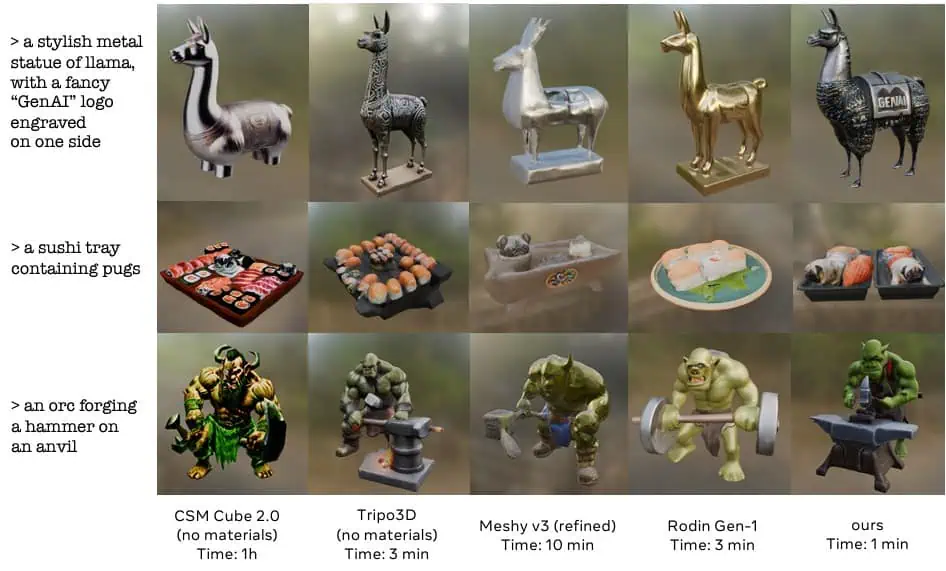

Meta 3D Gen (3DGen)を紹介します。これは、テキストから3Dアセット生成のための最先端の高速パイプラインです。3DGenは、高いプロンプト忠実度、高品質な3Dシェイプとテクスチャを持つ3Dアセットを1分以内に作成します。実世界のアプリケーションで3Dアセットのリライティングに必要な物理ベースレンダリング(PBR)をサポートしています。さらに、3DGenは、ユーザーによって提供される追加のテキスト入力を使用して、以前に生成された(またはアーティストが作成した)3D形状のジェネレーティブ・リテクスチャリングをサポートします。3DGenは、当社がテキストから3D、テキストからテクスチャ生成のためにそれぞれ開発した主要な技術コンポーネント、Meta 3D AssetGenとMeta 3D TextureGenを統合しています。これらの長所を組み合わせることで、3DGenは3つの方法で同時に3Dオブジェクトを表現します:ビュー空間、ボリューム空間、UV(またはテクスチャ)空間です。これら2つのテクニックを統合することで、シングルステージモデルに対して68%の勝率を達成しました。我々は、3DGenを多くの業界のベースラインと比較し、複雑なテキストプロンプトのプロンプトの忠実度と視覚的品質において、3DGenがそれらを凌駕し、同時に著しく高速であることを示す。

Meta3DGenは、テキストから3D(Meta 3D AssetGen (Siddiqui et al., 2024))とテキストからテクスチャ(Meta 3D TextureGen (Bensadoun et al., 2024))生成のためのMetaの基盤モデルを統一されたパイプラインに統合し、PBRマテリアルマップを持つ多様で高品質なテクスチャ3Dアセットの効率的で最先端の作成と編集を可能にします。

既存技術(MeshyやTripo)との比較

既存技術(CSM、Tripo、Meshy、Rodin)との比較

これまた興味深い。この技術どう展開していくのかな?それともこれはまだ途中経過なのか。

現在PDFの論文データがダウンロード可能です。是非チェックしてみてください!

コメント