ウィッグなどをCT(Computed Tomography(コンピュータ断層撮影))スキャンし、そこで得られたデータからヘアーストランドを生成する技術「CT2Hair: High-Fidelity 3D Hair Modeling using Computed Tomography」が公開されています。

CT2Hair: High-Fidelity 3D Hair Modeling using Computed Tomography

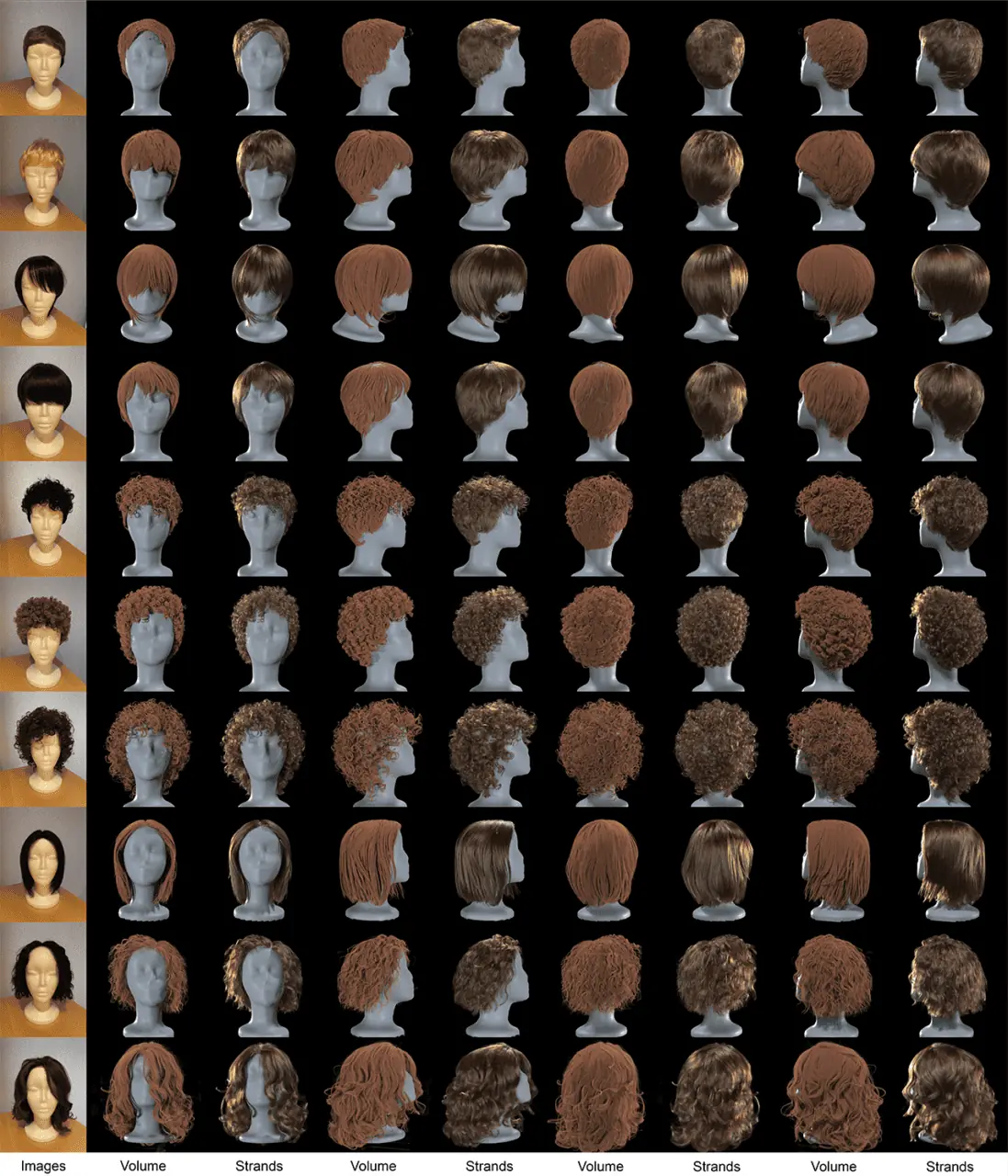

CT2Hairは、下流のグラフィックスアプリケーションで使用するのに適した、忠実度の高い3Dヘアモデルを作成するための完全自動フレームワークである。我々のアプローチは、入力として実世界の毛髪ウィッグを利用し、幅広いヘアスタイルの毛髪ストランドを再構成することができる。本手法では、コンピュータ断層撮影(CT)を活用して毛髪領域の密度ボリュームを作成するため、目に見える表面の再構成に限定される画像ベースのアプローチとは異なり、毛髪を透視することができます。入力密度ボリュームのノイズと解像度の限界に対処するため、粗いものから細かいものへのアプローチを採用している。このプロセスでは、まず、推定された3次元方位磁場を用いてガイドストランドを復元し、次に、ガイドストランドの新しいニューラル補間によって密なストランドを生成する。生成されたストランドは、入力された密度ボリュームに適合するように精緻化される。様々なヘアスタイルの結果を示し、実世界と合成データセットの両方で徹底的な評価を行うことで、本アプローチの頑健性を実証する。

我々のパイプラインは、粗いものから細かいものへのアプローチをとり、ガイドストランドの初期化と密なストランドの最適化の2つのステージから構成される。最初の段階は、入力された3D密度ボリュームから3D配向フィールドを計算することから始まります。次に、計算された方位を用いてガイドストランドを生成します。第2段階では、推定されたガイドストランドを頭皮上に均一に分布するように補間する。次に、元の密度ボリュームをターゲットとして、補間された毛束を最適化します。最適化された髪の束は、最終的な3Dヘアモデルであり、ダウンストリームアプリケーションへの準備が整いました。

CTスキャンを行う時点で個人で手軽に使えるものではないですが…

中々高品質なデータが構築出来そうですよね。コードなども既に公開中ですので、気になる方はプロジェクトページをご確認ください。

コメント